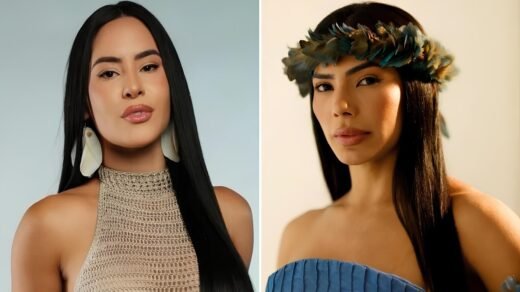

Imagens falsas criadas por inteligência artificial a partir de fotos comuns se espalham na internet e acendem alerta sobre abuso digital

O avanço acelerado da Inteligência Artificial (IA) tem impulsionado inovações tecnológicas em diversas áreas, mas também trouxe uma preocupação crescente: a proliferação de deepfakes de conteúdo sexual. Essas imagens falsas, muitas vezes criadas a partir de fotos comuns retiradas de redes sociais, são manipuladas por algoritmos para parecerem extremamente realistas.

Foto: Divulgação

Dados de especialistas em segurança digital indicam que cerca de 98% dos deepfakes detectados online possuem conteúdo sexual não consensual direcionado a mulheres e meninas, o que revela um cenário alarmante de abuso digital.

Um dos casos que ganhou repercussão internacional é o de Sophie Parrish, moradora do norte da Inglaterra, que se tornou um dos rostos da luta contra esse tipo de crime após descobrir que imagens pornográficas criadas por inteligência artificial com o seu rosto estavam circulando na internet sem autorização.

De acordo com especialistas, o alto nível de realismo dessas montagens torna difícil para as vítimas comprovar que o material é falso. Além do impacto na reputação, muitas pessoas afetadas relatam danos à saúde mental e sensação constante de insegurança.

“O problema não é apenas a foto em si, mas o fato de que, uma vez na rede, o controle sobre o próprio corpo é roubado por um algoritmo”, alertam especialistas em segurança digital.

Diante da gravidade da situação, o Parlamento do Reino Unido aprovou medidas para reforçar a legislação contra esse tipo de prática. As novas regras aumentam as punições para quem cria, compartilha ou lucra com deepfakes sexualizados.

A legislação também passa a responsabilizar plataformas digitais que não removam o conteúdo com rapidez ou que permitam que algoritmos ampliem a circulação dessas imagens.

Mesmo com o endurecimento das leis, especialistas alertam que um dos maiores desafios continua sendo a permanência do conteúdo na internet. Mesmo após remoções e decisões judiciais, os arquivos podem reaparecer em fóruns ou ser redistribuídos por usuários que os baixaram anteriormente.

Diante desse cenário, pesquisadores e empresas de tecnologia trabalham no desenvolvimento de ferramentas capazes de detectar automaticamente esse tipo de material, bloqueando sua publicação antes mesmo que chegue às redes.